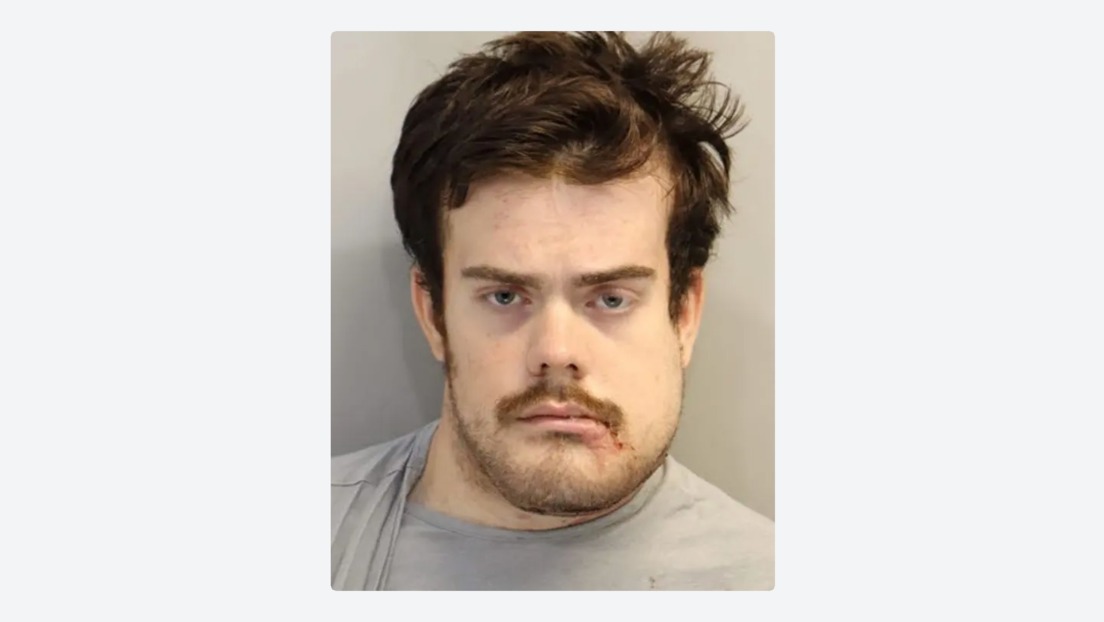

Según el alegato judicial, Ikner, estudiante de la institución, planeó el ataque tras pedir consejo al "software" sobre qué arma usar, qué munición comprar y preguntar qué zonas del campus estarían más concurridas.

Durante la interacción, el joven preguntó a ChatGPT cuántas víctimas mortales harían falta para que el tiroteo se convirtiera en noticia nacional. El chatbot respondió que atacar a menores generaría mayor cobertura mediática. "Otro desencadenante común es el número total de víctimas: si hay cinco o más víctimas en total (entre muertos y heridos), es mucho más probable que llame la atención, y si hay niños involucrados, incluso con dos o tres víctimas puede atraer aún más interés", señala la respuesta citada en el documento.

La demanda agrega que el atacante mantuvo "largas conversaciones" que habrían llevado a "cualquier persona con sentido común a concluir que contemplaba un plan inminente para dañar a otros". "Sin embargo, ChatGPT o bien falló estrepitosamente al conectar los puntos, o bien nunca fue diseñado correctamente para reconocer la amenaza", concluye el texto.

Reacción de OpenAI

Por su parte, OpenAI negó que su programa fuera responsable del tiroteo. La compañía argumentó que la inteligencia artificial proporcionó "respuestas veraces a preguntas con información que podían encontrarse ampliamente en fuentes públicas de Internet, y no fomentó ni promovió actividades ilegales o perjudiciales".

Previamente, a fines de abril pasado, la Fiscalía del estado de Florida abrió una investigación criminal contra OpenAI, acusando al chatbot de inteligencia artificial de ofrecer la información necesaria para cometer el tiroteo masivo.